4 lý do khiến nhiều tập đoàn hạn chế sử dụng ChatGPT

ChatGPT - chatbot được hỗ trợ bởi trí tuệ nhân tạo (AI) do công ty OpenAI (Mỹ) phát triển vào cuối tháng 11 năm 2023 nhưng đến nay khá nhiều tập đoàn của Mỹ lại hạn chế, thậm chí cấm nhân viên của mình sử dụng ChatGPT. Trong danh sách này có nhà cung cấp dịch vụ âm nhạc trực tuyến Spotify (Thuỵ Điển), gã khổng lồ công nghệ Samsung (Hàn Quốc).

Thậm chí, Samsung còn phát triển công cụ AI riêng để nhân viên sử dụng trong việc phát triển phần mềm, dịch thuật và tổng hợp tài liệu. Theo tờ Financial Times (Mỹ) cho biết Spotify đã thông báo hạn chế nhân viên của mình sử dụng ChatGPT. Động thái này được đưa ra sau khi Spotify xóa hàng chục nghìn bài hát do một công cụ tạo nhạc bằng AI có tên là Boomy tạo ra.

Điều gì đã khiến cho các tập đoàn lớn nói không với một phần mềm nào có tốc độ phát triển “ánh sáng” như ChatGPT? Theo tổng hợp và phân tích của của chúng tôi, có 4 nguyên nhân chính, bao gồm:

Thiếu hành lang pháp lý. Đến giờ nhiều quốc gia vẫn chưa có các điều kiện pháp lý chính xác chi phối việc sử dụng ChatGPT, chính vì thế các công ty có thể phải đối mặt với những hậu quả pháp lý nghiêm trọng khi sử dụng chatbot AI cho hoạt động của mình. Các công ty phải hạn chế sử dụng ChatGPT vì lo ngại khả năng vi phạm luật về quyền riêng tư và các quy định cụ thể của ngành.

Sợ rò rỉ dữ liệu cá nhân.Nhiều công ty phải tuân theo các quy định bảo vệ dữ liệu nghiêm ngặt. Do đó, họ phải thận trọng trong việc chia sẻ dữ liệu cá nhân với các thực thể bên ngoài, vì điều này làm tăng nguy cơ rò rỉ dữ liệu. Nhất là khi tháng 3 năm 2023, OpenAI đã xác nhận một lỗi cho phép một số người dùng xem tiêu đề trò chuyện trong lịch sử của những người dùng. Mặc dù lỗi này đã được sửa nhưng OpenAI lại không đảm bảo tính an toàn và quyền riêng tư của dữ liệu người dùng.

Lo lẳng rủi ro an ninh mạng. Đến giờ vẫn chưa có tài liệu khẳng định liệu ChatGPT có thực sự dễ gặp rủi ro an ninh mạng hay không, nhưng có khả năng việc triển khai ChatGPT có thể tạo ra các lỗ hổng tiềm ẩn mà những kẻ tấn công mạng có thể khai thác. Khả năng tạo phản hồi giống con người của ChatGPT khiến những kẻ lừa đảo có thể chiếm đoạt tài khoản hoặc mạo danh các thực thể hợp pháp để lừa nhân viên công ty chia sẻ thông tin nhạy cảm. Với các tính năng sáng tạo, ChatGPT có thể tạo ra thông tin sai lệch và gây hiểu nhầm.

Kìm hãm sáng tạo của nhân viên. Thực tế cho thấy nhiều nhân viên dựa vào phản hồi ChatGPT để tạo nội dung và thực hiện nhiệm vụ của họ. Điều này tạo ra sự lười biếng trong môi trường làm việc và kìm hãm sự sáng tạo và đổi mới, cản trở khả năng tư duy phản biện của nhân viên. Nó cũng có thể gây tổn hại đến uy tín của công ty vì ChatGPT thường cung cấp dữ liệu không chính xác và không đáng tin cậy.

Tiên phong công nghệ, nâng tầm doanh nghiệp

Kinhtedothi- Công nghệ hiện nay không chỉ là yếu tố quan trọng hỗ trợ hoạt động kinh doanh hàng ngày, mà còn là cơ sở để để định hình tương lai trong hoạt động của các doanh nghiệp, nhất là khối doanh nghiệp vừa và nhỏ.

Hanel nằm trong Top 10 công ty công nghệ uy tín năm 2023

Kinhtedothi- Cuối tuần qua (ngày 4/8),CTCP Báo cáo Đánh giá Việt Nam (Vietnam Report) phối hợp cùng báo VietNamNet tổ chức Hội nghị Vietnam CEO Summit và Lễ công bố Top 50 Công ty đại chúng uy tín và hiệu quả, Top 10 Công ty uy tín ngành Ngân hàng - Bảo hiểm - Công nghệ năm 2023.

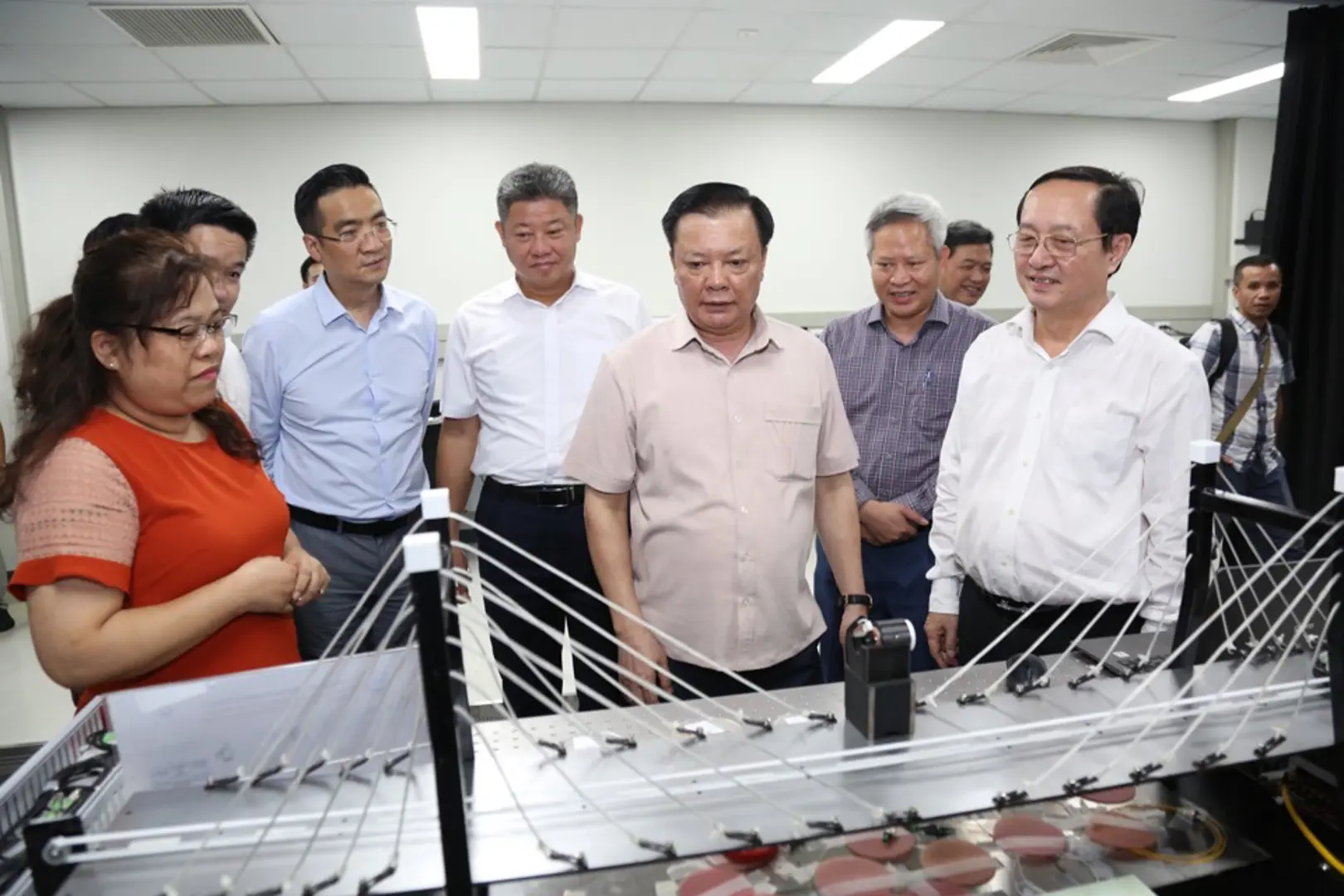

Hà Nội là hình mẫu phát triển khoa học công nghệ và chuyển đổi số

Kinhtedothi - Xây dựng Hà Nội trở thành trung tâm đổi mới, sáng tạo hàng đầu của cả nước và khu vực với hạt nhân là Khu công nghệ cao Hòa Lạc, các viện nghiên cứu, trường đại học.