Sunday, 16:30 05/08/2018

Những dự đoán đáng sợ về trí tuệ nhân tạo

Kinhtedothi - Những bộ phim Hollywood như "Blade Runner" và "The Terminator" đã mang đến cho người xem nỗi lo ngại rằng trí tuệ nhân tạo (AI) sẽ có khả năng kiểm soát con người.

AI là một từ thông dụng được tung ra thường xuyên trong thế giới kinh doanh và trên các phương tiện truyền thông. Khi AI ngày càng gần đến mức trưởng thành hơn, và các doanh nghiệp tiếp tục tăng cường đầu tư vào nó, một số lo lắng về các tác động vào xã hội và những vấn đề về đạo đức trong công nghệ tương lai đâng được quan tâm nhiều hơn.

Thất nghiệp hàng loạt

Một nỗi lo chung của các nhà phân tích cho những người công nhân, là AI sẽ đưa bộ máy sản xuất trở nên tự động hóa và có thể dẫn đến nạn thất nghiệp hàng loạt trên toàn cầu.

"Mất việc làm có lẽ là mối lo lớn nhất", Alan Bundy, giáo sư tại trường tin học của trường Đại học Edinburgh cho biết.

Những người ủng hộ AI nói rằng công nghệ sẽ dẫn đến việc tạo ra các loại công việc mới. Vai trò của các kỹ sư cũng trở nên quan trọng hơn, vì ngành công nghệ đòi hỏi những tài năng có thể phát triển nó. Đồng thời, con người cũng sẽ buộc sử dụng AI khi chúng xâm nhập và đóng một vai trò cần thiết trong cuộc sống hàng ngày của họ.

Công ty nghiên cứu Gartner dự đoán rằng AI sẽ tạo ra 2,3 triệu việc làm và làm 1,8 triệu người thất nghiệp (tăng 500.000 việc làm) cho đến năm 2020. Điều đó không làm nảy sinh thực tế rằng nó sẽ dẫn đến tình trạng sa thải hàng loạt trên toàn thế giới.

Chiến tranh

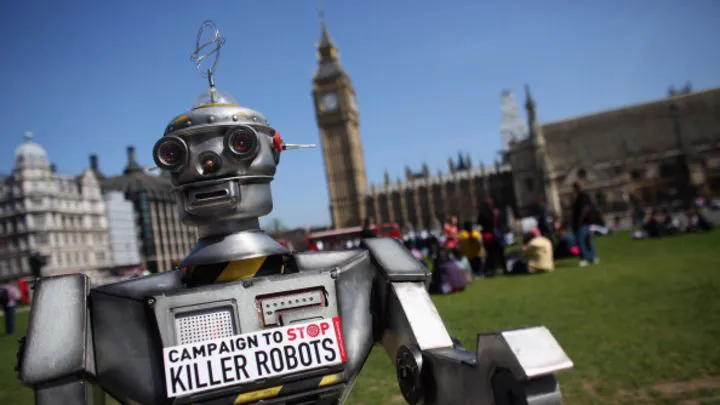

Những ứng dụng của AI trong quân sự có thể sinh ra nhiều mối lo ngại trong đó có “Robot chiến đấu” có thể dẫn đến nhiều xung đột chiến tranh.

Giám đốc điều hành Tesla Elon Musk, đã đưa ra những quan điểm thẳng thắn của mình về AI. Ông cảnh báo vào năm ngoái rằng công nghệ này có thể dẫn đến Chiến tranh Thế giới III.

Mặc dù nhận xét của Musk có thể là phóng đại vấn đề nhưng nó cũng tạo ra một nỗi sợ hãi thực sự cho các chuyên gia. Một số nhà phân tích và các nhà vận động tranh luận cho rằng việc phát triển vũ khí tự động và việc sử dụng AI trong các quyết định quân sự sẽ tạo ra vô số các sai lệch về đạo đức và các tình huống tồi tệ xảy ra.

Thậm chí còn có một nhóm các tổ chức phi chính phủ dành riêng cho việc cấm các loại máy như vậy. Một chiến dịch ngăn chặn Robot chiến đấu được thiết lập vào năm 2013, kêu gọi các chính phủ ngăn chặn sự phát triển của máy bay không người lái được hỗ trợ bởi AI và các phương tiện khác.

Đầu năm nay, tập đoàn tư vấn quốc phòng Mỹ Rand Corporation cảnh báo trong một nghiên cứu rằng việc sử dụng AI trong các ứng dụng quân sự có thể dẫn đến một cuộc chiến hạt nhân vào năm 2040.

Những lo lắng này xuất phát từ một vụ tai tiếng khét tiếng năm 1983, khi cựu sĩ quan quân đội Liên Xô Stanislav Petrov nhận thấy rằng các máy tính của Nga đã đưa ra một cảnh báo sai rằng Mỹ đã phóng tên lửa hạt nhân, và may mắn là cuộc chiến tranh hạt nhân đã không xảy ra.

Robot bác sĩ

Hầu hết các chuyên gia đều nhất trí về những lợi ích mà AI sẽ cung cấp cho các ngành y tế, chẳng hạn như chẩn đoán bệnh sớm và nâng cao những trải nghiệm về chăm sóc sức khỏe tổng thể.

Tuy nhiên, vào tuần trước, một báo cáo của ấn phẩm chuyên về y tế Stat trích dẫn các tài liệu nội bộ của IBM cho thấy siêu máy tính Watson khổng lồ của công nghệ cao đã đưa ra nhiều khuyến cáo điều trị ung thư "không an toàn và không chính xác".

Theo bài báo, phần mềm này chỉ được huấn luyện để đối phó với một số ít trường hợp và các kịch bản giả định hơn là dữ liệu bệnh nhân thực tế.

Một mối quan tâm khác là khối lượng dữ liệu được các máy tính đưa vào và chia sẻ, cũng như các thuật toán hướng dữ liệu tự động hóa các ứng dụng liệu có thể đảm bảo được quyền riêng tư của bệnh nhân hay không.

Lấy ví dụ là DeepMind - Công ty AI do Google sở hữu đã ký một thỏa thuận với Dịch vụ Y tế Quốc gia của Anh vào năm 2015, cho phép truy cập dữ liệu sức khỏe của 1,6 triệu bệnh nhân người Anh. Đề án này có nghĩa là công ty sẽ sử dụng dữ liệu của bệnh nhân cung cấp để cải thiện khả năng phát hiện bệnh tật của chương trình. Một ứng dụng gọi là Streams đã được tạo ra, nhằm theo dõi bệnh nhân bị bệnh thận và cảnh báo các bác sĩ lâm sàng khi tình trạng bệnh nhân xấu đi.

Nhưng năm ngoái, Cơ quan Giám sát Quyền riêng tư của Anh là Văn phòng Ủy viên Thông tin (ICO) đã phán quyết rằng hợp đồng giữa NHS và DeepMind "không tuân thủ luật bảo vệ dữ liệu". ICO nói rằng Royal Free Hospital của London, nơi làm việc với DeepMind theo thỏa thuận, đã không minh bạch về cách sử dụng dữ liệu của bệnh nhân.

Giám sát hàng loạt

Các chuyên gia cũng lo sợ rằng AI có thể được sử dụng để giám sát hàng loạt. Ở Trung Quốc , nỗi sợ đó dường như đang trở thành hiện thực.

Ở nhiều thành phố của Trung Quốc, sự kết hợp của công nghệ nhận diện khuôn mặt và AI đang được chính quyền sử dụng với tính năng hạn chế tội phạm.

Theo một báo cáo của tờ New York Times, Trung Quốc hiện có khoảng 200 triệu camera giám sát. Đây cũng là quốc gia duy nhất trên thế giới tung ra một "hệ thống tín dụng xã hội" theo dõi các hoạt động của công dân để xếp hạng chúng với điểm số có thể xác định liệu họ có thể cấm truy cập mọi thứ từ chuyến bay trên máy bay đến các dịch vụ hẹn hò trực tuyến nhất định hay không.

Trung Quốc, đang cạnh tranh để trở thành nhà lãnh đạo toàn cầu về AI vào năm 2030, muốn tăng giá trị của ngành AI lên 1 nghìn tỷ NDT (146,6 tỷ USD). Đất nước đang đổ hàng tỷ đô la vào lĩnh vực này để giúp thúc đẩy tham vọng này.

SenseTime của Alibaba được cho công ty khởi nghiệp về AI có giá trị nhất trên thế giới, với trị giá 4,5 tỷ USD, đã cung cấp các cơ quan chức năng tại Quảng Châu và tỉnh Vân Nam với nhận dạng khuôn mặt do AI cung cấp.

SenseTime cho biết trên trang web của mình rằng văn phòng công an của Quảng Châu đã xác định hơn 2.000 nghi phạm tội phạm kể từ năm 2017 với sự trợ giúp của công nghệ.

Tags